ИИ может предсказать будущее, но не может его создать. Это прерогатива человека.

Л. Вей, К. Дин и Х. Ху. «Автоматическое обнаружение рака кожи на дерматоскопических изображениях на основе облегченной сети глубокого обучения Ensemble», 2019

В лабиринтах алгоритмов, где данные превращаются в пророчества, а код обретает голос оракула, искусство вступает в новую эру. Искусственный интеллект, словно древний провидец, пытается расшифровать тайный язык будущего, предсказывая все, от тенденций на бирже до диагнозов пациентов.

Здесь мы исследуем, как художники используют алгоритмы не только для генерации изображений или музыки, но и для критического осмысления самой природы предсказания ИИ, его возможностей и ограничений.

Художественные проекты, основанные на ИИ, превращаются в своеобразные «лаборатории будущего». Они не просто предсказывают, но и критически анализируют наши ожидания от технологий, раскрывая скрытые предубеждения и «слепые зоны» алгоритмов, которые зачастую остаются незамеченными в научных исследованиях.

Прежде чем погрузиться в мир художественных исследований природы ИИ, важно обратиться к более широкому контексту использования этой технологии, в частности, к ее применению в медицине. Этот пример поможет нам лучше понять, каким образом формируется критика ИИ в современном искусстве и почему художники акцентируют внимание на ограничениях и потенциальных опасностях алгоритмических предсказаний. Ведь именно в таких областях, как медицина, ошибки ИИ могут иметь наиболее серьезные последствия.

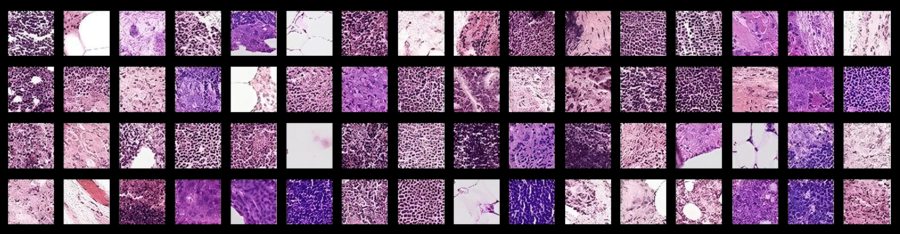

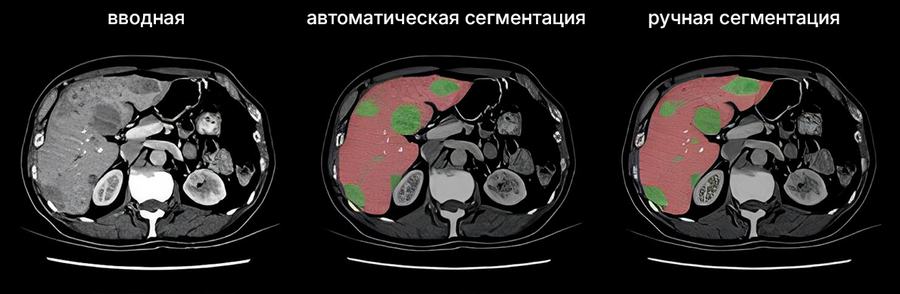

Автоматическая сегментация опухолей головного мозга с помощью каскадных анизотропных свёрточных нейронных сетей

Результаты сегментации почек (первая строка) и опухолей (вторая строка).

Столбец A: поперечные срезы КТ. Столбец B: сегментация вручную, выполненная экспертом. Столбец C: автоматическая сегментация с помощью CNN U-Net. Столбец D: сегментация с помощью CNN U-Net + метод обучения OV2ASSION

Одним из наиболее ярких проявлений «провидческих» способностей ИИ стала его интеграция в медицинскую диагностику. Алгоритмы, обученные на миллионах медицинских изображений, способны выявлять заболевания с высокой точностью, предсказывая их развитие и помогая врачам в принятии решений. Однако, как и любой инструмент предсказания, ИИ не лишен недостатков. Его «видение» может быть замутнено «биасами» — искажениями, возникающими из-за нерепрезентативности данных или скрытых предубеждений, заложенных в самой структуре алгоритмов.

подробнее про Биасы искусственного интеллекта и о том, почему они опасны, можно прочесть здесь

Именно поэтому разработка методов выявления и нейтрализации этих биасов становится критически важной задачей. Одним из подходов к решению этой проблемы является методология, описанная в статье, посвященной инструменту СимБА (Simulated Bias in Artificial Medical Images). СимБА — это своеобразный «тренажер» для алгоритмов, создающий синтетические медицинские изображения с искусственно усиленными биасами. Эти «испорченные» данные используются для обучения диагностических моделей ИИ, чтобы повысить их устойчивость к реальным искажениям, которые могут присутствовать в настоящих медицинских изображениях.

пример работы нейронной сети СимБА

Этот проект интересен с художественной точки зрения, так как представляет собой пример рекурсивного использования ИИ: одна модель искусственного интеллекта используется для обучения другой модели преодолевать собственные недостатки. SimBA, осознанно создавая искаженные данные, имитирует процесс возникновения ошибок в человеческом восприятии и мышлении. Этот процесс «обучения через ошибку» можно рассматривать как метафору художественного творчества, где эксперимент и ошибка являются неотъемлемой частью поиска новых форм и смыслов.

Машина учит машину не ошибаться, ошибаясь сама

Сегментация изображения с помощью CNN для выделения опухолей

— эта формулировка подчеркивает парадоксальность и поэтичность данного подхода, превращая техническое решение в своеобразный арт-объект. Проект ставит вопросы о природе творчества, объективности технологий и границе между научным исследованием и художественным вы высказыванием.

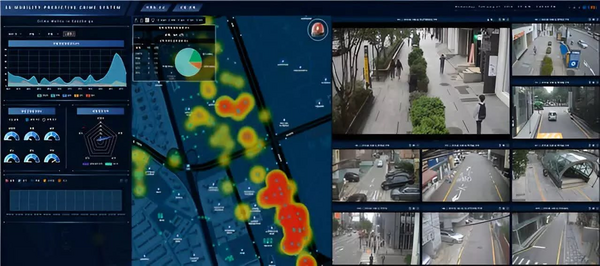

«Dejaview» 2024

В современном мире, охваченном сетями видеонаблюдения, алгоритмы все чаще берут на себя роль предсказателей преступлений, пытаясь предотвратить нарушения закона еще до их совершения. Система «Дежавю», разработанная в Южной Корее, анализирует данные с камер видеонаблюдения, выявляя потенциально опасные ситуации и предупреждая правоохранительные органы. Этот проект, подобно ИИ в медицине, демонстрирует стремление использовать алгоритмы для прогнозирования и предотвращения нежелательных событий. Однако, он также поднимает сложные этические вопросы о границах наблюдения, о потенциале для дискриминации и о роли человеческого фактора в принятии решений, основанных на предсказаниях ИИ. Эти и другие вопросы становятся предметом художественного осмысления в работах, которые мы рассмотрим далее.

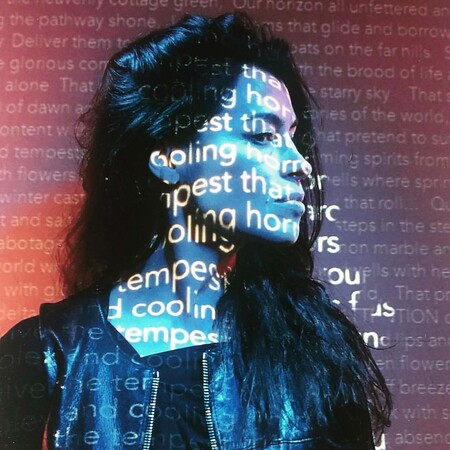

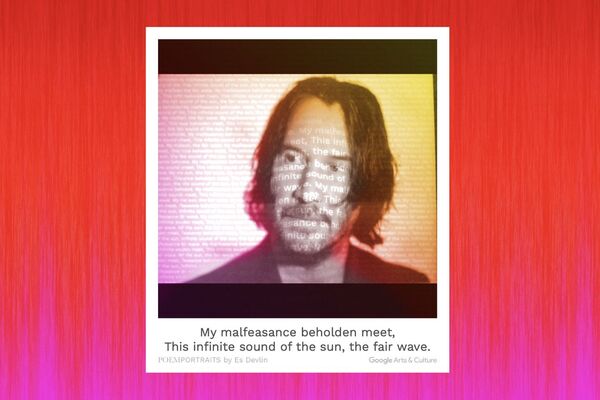

Эс Делвин: «Портрет из поэм» 2021

Переходя от анализа биасов в науке и социуме к исследованию ИИ в искусстве, обратимся к проекту Эс Девлин «Портрет из поэм». Эта работа, представляющая собой социальную скульптуру, созданную с помощью машинного обучения, демонстрирует иной аспект «оракульной» природы ИИ — его способность генерировать тексты и создавать новые формы поэтического выражения. В «Портрет из поэм» алгоритм, обученный на миллионах стихов, выступает в роли своеобразного поэта-оракула, создавая уникальные двустишия на основе слов, предлагаемых зрителями. Каждый участник проекта жертвует одно слово, которое становится частью коллективного «портрета», сплетенного из фрагментов стихов.

Эс Делвин: «Портрет из поэм» 2021

Здесь ИИ не предсказывает будущее в традиционном смысле, но он создает новые смыслы, новые поэтические комбинации, предсказывая, какое слово может следовать за другим, какой образ может возникнуть из случайного сочетания слов и формы лица зрителя. Этот процесс алгоритмической генерации текста можно рассматривать как своеобразную форму «оракульного» творчества, где ИИ выступает в роли посредника между человеческим замыслом и случайностью, порождая неожиданные поэтические откровения.

Фрэнсис Гальтон: «композитные портреты», 1880-е

Фрэнсис Гальтон: «составной портрет», 1879

Размышляя о «провидческой» роли ИИ, нельзя не обратиться к историческим прецедентам попыток «прочитать» человека и предсказать его поведение по внешним признакам. В конце XIX века Фрэнсис Гальтон разработал метод создания «композитных портретов» путем наложения друг на друга фотографий людей, обладающих определенными характеристиками — например, преступников или больных туберкулезом. Гальтон полагал, что такие композиты раскроют «типичные» черты, присущие данной группе, и позволят выявлять склонность к определенному поведению. Параллельно с ним итальянский врач Чезаре Ломброзо развивал теорию физиогномики, утверждая, что преступников можно опознать по специфическим анатомическим особенностям. Эти теории, хоть и были впоследствии признаны псевдонаучными, демонстрируют стремление человека найти связь между внешним обликом и внутренней сущностью, предсказать поведение на основе визуальных данных.

Современные алгоритмы ИИ, анализируя огромные массивы изображений и используя сложные методы распознавания образов, в некотором смысле продолжают эту традицию.

Однако, в отличие от Гальтона и Ломброзо, ИИ оперирует не с абстрактной информацией, а с конкретными данными, что делает его предсказания более точными и обоснованными. Тем не менее, важно помнить об опасности биасов и ошибочных интерпретаций, которые могут возникнуть и при использовании самых совершенных алгоритмов.

Чезаре Ломборзо, женские лица, склонные к преступлениям, 1876

Тем не менее, важно помнить об опасности предубеждений и ошибочных интерпретаций, которые могут возникнуть и при использовании самых совершенных алгоритмов. Ярким примером критического осмысления этой проблемы в искусстве служит проект Клемана Ламбле «Математика регрессии». В работе художник обращается к базе данных фотографий арестованных, которая используется для обучения алгоритмов распознавания лица.

Клеман Ламбле: «Математика регрессии», 2019-2022

55 тысяч изображений, собранных системой уголовного правосудия США, несут на себе отпечаток системного расизма, и Ламбле использует ИИ, чтобы выявить и визуализировать эти скрытые предубеждения.

Клеман Ламбле: «Математика регрессии», 2019-2022

Создавая композитные портреты по полу и возрасту, алгоритм генерирует «идеальных алгоритмических подозреваемых» — стереотипные образы, отражающие расовые биасы, заложенные в технологии. Однако, Ламбле идет дальше простой констатации проблемы. Используя принцип суперпозиции, он сохраняет анонимность отдельных лиц, не допуская дальнейшей эксплуатации человеческой индивидуальности.

Клеман Ламбле: «Математика регрессии», 2019-2022

«Математика регрессии» — это не просто художественный проект, но и акт сопротивления, направленный против «нормализации» расизма через технологии. Он демонстрирует, как ИИ, обученный на искаженных данных, может усиливать существующие социальные неравенства, создавая замкнутый круг дискриминации.

Сяолинь Ву, Си Чжан: «Автоматизированный вывод о преступности», 2011

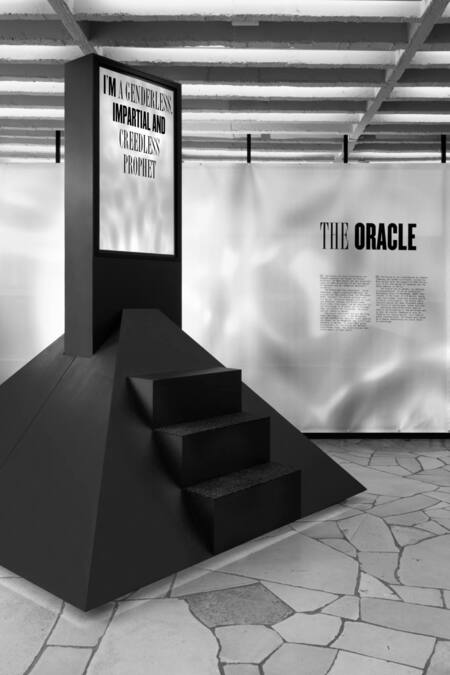

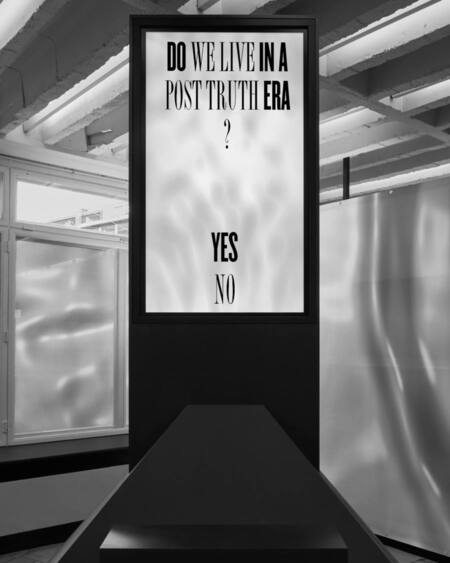

Клемент Ламбеле: «Оракул», 2018

Теперь обратимся к проекту, который исследует саму природу оракула в контексте современных технологий. «Оракул» Клемана Ламбле — это интерактивная мультимедийная инсталляция, представляющая собой своеобразный алтарь будущего. Лишенный гендера, идеологии и предубеждений, этот цифровой оракул предлагает посетителям советы и прогнозы, основанные на анализе данных, и обратной связи от самих участников. «Оракул» не претендует на абсолютную истину, но он стимулирует размышления о нашем настоящем и будущем, о нашей вере в технологии и о границе между предсказанием и случайностью.

Клемент Ламбеле: «Оракул», 2018

В эпоху неопределенности «Оракул» становится не столько источником готовых ответов, сколько катализатором для критического осмысления роли технологий в нашей жизни и нашего собственного места в будущем.

Он заставляет нас задуматься о том, насколько мы готовы довериться алгоритмам и какую цену мы готовы заплатить за иллюзию предсказуемости в мире, который становится все более сложным и непредсказуемым.

Скотт Итан: «Пересекая Шибую», 2024

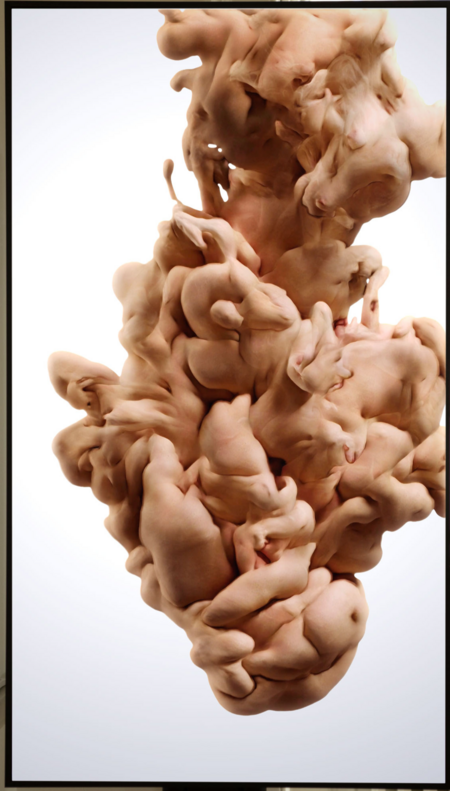

В проекте «Пересекая Шибую» Скотт Итан использует ИИ, который извлекает художественный смысл из данных общественного наблюдения. Алгоритмы анализируют движение толпы на перекрестке Шибуя, присваивая каждому прохожему идентификатор и «вероятность человечности».

Цвет каждого элемента коллажа зависит от направления движения, времени пребывания в кадре и той самой «алгоритмической человечности».

ИИ превращает хаос городского потока в постоянно меняющуюся визуальную поэму, провоцируя размышления о цене технологического прогресса для нашей приватности.

Скотт Итан: «Гиперболическая композиция I», 2018 (слева), «Гиперболическая композиция II», 2018 (справа)

Скотт Итан, «Развлечения с кофеином», 2019

Скотт Итан, «Человечество (Падение проклятых)», 2020 (слева), «запутанный», 2019 (справа)

Скотт Итан: «запутанный», 2019

«Оракул» заставляет нас задуматься о том, насколько мы готовы довериться алгоритмам и какую цену мы готовы заплатить за иллюзию предсказуемости в мире, который становится все более сложным и непредсказуемым. В своей сути, стремление к предсказанию будущего — это отражение глубинной человеческой потребности в контроле и понимании окружающего мира. Искусственный интеллект, с его способностью анализировать огромные массивы данных и выявлять скрытые закономерности, становится мощным инструментом в этом поиске. Он позволяет нам заглянуть за границы привычного, расширить горизонты восприятия и, возможно, даже приблизиться к разгадке тайн будущего. Однако, как и любой оракул, ИИ не дает однозначных ответов. Его предсказания — это лишь вероятностные модели, подверженные ошибкам и искажениям. Именно поэтому критическое осмысление роли ИИ как «провидца», а также поиск баланса между доверием к технологиям и сохранением человеческой интуиции и критического мышления становятся ключевыми задачами в эпоху цифровой трансформации.

ГЛОССАРИЙ

Оракул (от лат. oraculum — «божественное откровение, предсказание») — в древности место, где люди обращались к божествам за советами и предсказаниями будущего. Оракулом также называли самого жреца или прорицателя, который истолковывал волю богов. В современном контексте оракул — это любой источник предсказаний или прогнозов, будь то человек, технология или явление природы. В связи с развитием искусственного интеллекта понятие оракула приобретает новое звучание. Алгоритмы, способные анализировать огромные массивы данных и выявлять скрытые закономерности, все чаще воспринимаются как современные оракулы, предсказывающие будущее в различных сферах человеческой деятельности.